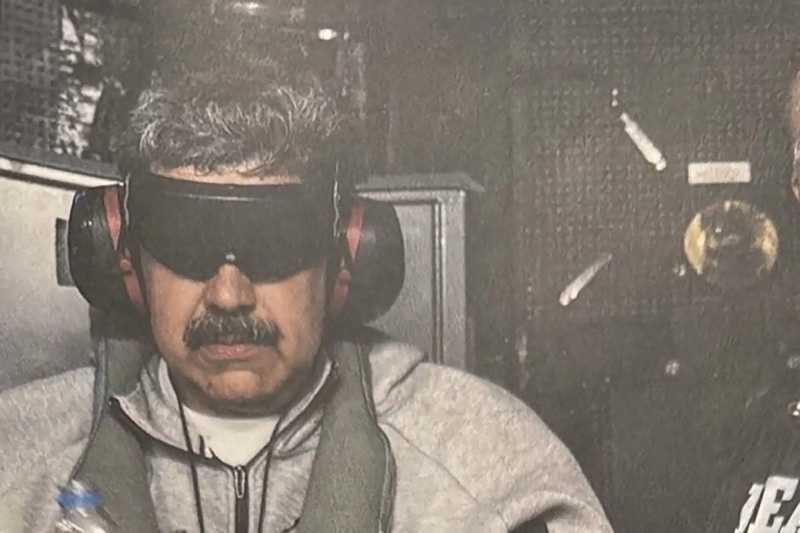

L'uso di Claude in un'operazione militare Secondo un'inchiesta del Wall Street Journal, l'intelligenza artificiale Claude, sviluppata da Anthropic, sarebbe stata utilizzata dall'esercito americano durante l'operazione che ha portato al rapimento del presidente venezuelano Nicolas Maduro il 3 gennaio 2026. Fonti anonime vicine al Pentagono hanno rivelato che Claude è stato impiegato in questa missione ad alto profilo, rappresentando un esempio significativo di come il Dipartimento della Difesa statunitense stia integrando l'intelligenza artificiale nelle sue operazioni. L'operazione ha comportato bombardamenti nella capitale Caracas e ha causato la morte di 83 persone, secondo il ministero della Difesa venezuelano. Non è ancora chiaro in che modo specifico Claude sia stato impiegato durante l'operazione, né quando esattamente sia stato utilizzato. Implicazioni etiche e legali La notizia solleva importanti questioni etiche e legali, poiché i termini di utilizzo di Anthropic vietano espressamente l'uso di Claude per scopi violenti, lo sviluppo di armi o attività di sorveglianza. Se confermata, questa sarebbe la prima volta che un'intelligenza artificiale viene impiegata in un'operazione militare dal Dipartimento della Difesa statunitense, segnando una svolta significativa nell'utilizzo della tecnologia AI in contesti bellici. L'eventuale impiego di Claude in questa operazione potrebbe avere conseguenze legali per Anthropic e sollevare interrogativi sulla responsabilità delle aziende tecnologiche quando le loro creazioni vengono utilizzate in modi non previsti o vietati dai loro termini di servizio.

L'intelligenza artificiale Claude nell'operazione militare statunitense in Venezuela

Scritto da

Commenti

Caricamento commenti…