Negli ultimi giorni è circolato un video che documenta l'incidente mortale in cui ha perso la vita Vince Zampella; alcune voci sostengono che il filmato sia stato generato o manomesso tramite intelligenza artificiale. Questo articolo verifica le informazioni disponibili, descrive le tecnologie che rendono possibile la creazione di video deepfake, valuta i segnali utili per distinguere immagini autentiche da manipolate e discute le conseguenze giornalistiche, legali ed etiche della diffusione di materiali sensibili. L'analisi si basa su fonti giornalistiche affidabili e su riferimenti tecnici per offrire al lettore elementi concreti per giudicare la credibilità del filmato.

Cosa mostrano i video circolati e quali sono le fonti principali

Diversi media italiani e internazionali hanno pubblicato e descritto un video che riprende l'incidente in cui ha perso la vita Vince Zampella: testate come TGCom24 e Corriere della Sera - Video hanno pubblicato descrizioni e spezzoni, segnalando che il filmato mostra una Ferrari uscire di strada lungo la Angeles Crest Highway e prendere fuoco durante l'incidente.

I reportage indicano che il video proviene da riprese amatoriali o da telefoni di testimoni e che è ora oggetto di verifica da parte delle autorità; testate come La Gazzetta riportano che le forze dell'ordine hanno avviato un'indagine sulle cause dell'incidente, mentre i giornali hanno pubblicato sia il filmato sia ricostruzioni del fatto.

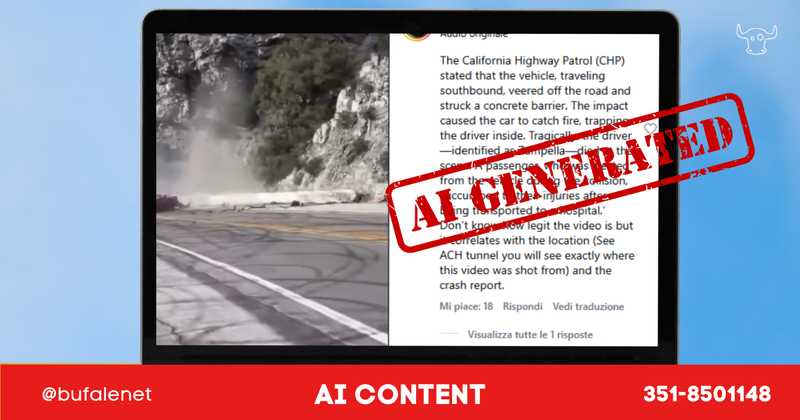

Contemporaneamente alla pubblicazione su testate consolidate sono emerse discussioni sui social che ipotizzano una possibile manipolazione digitale del video, soprattutto alla luce della crescente qualità dei "deepfake" video generati con strumenti di intelligenza artificiale; la presenza del filmato sulle piattaforme è quindi diventata anche un caso di verifica giornalistica oltre che di cronaca stessa.

Come l'AI può creare o alterare video: tecniche e limiti

Negli ultimi anni le tecnologie di intelligenza artificiale hanno reso possibile la produzione di video falsi molto realistici: tecniche come i modelli generativi video, Il face swapping in tempo reale e la ricostruzione 3D a partire da poche immagini possono alterare aspetti visivi e sonori di una sequenza, come spiegano analisi e guide tecniche dedicate alla generazione di deepfake e media sintetici.

Tuttavia, la creazione di un video realistico di un incidente complesso presenta limiti tecnici: ricreare dinamiche fisiche accurate, danni meccanici coerenti, interazioni di luce e fumo e la resa dettagliata di persone e ambienti richiede dataset molto ampi e competenze di post-produzione; questi elementi rendono più difficile — ma non impossibile — la produzione di falsi credibili rispetto alla manipolazione di volti in contesti statici.

Per questi motivi gli esperti consigliano di esaminare metadati, punti di vista inconsistenti, artefatti di compressione, tracce audio e la corrispondenza tra danni materiali e traiettorie: tali controlli tecnici sono strumenti pratici per valutare se un video possa essere stato generato o pesantemente alterato con strumenti di AI.

Indicatori pratici per valutare l'autenticità del filmato

Un primo passaggio utile è verificare la provenienza e la cronologia della pubblicazione: se il video è apparso inizialmente su account anonimi o piattaforme poco tracciabili, la cautela aumenta; testate giornalistiche autorevoli come TGCom24 e il Corriere - Video possono offrire contesto e conferme incrociate sulla fonte originale delle riprese.

Analisi tecnica: controllare i metadati del file (se disponibili), cercare incoerenze nella luce, ombre errate, artefatti di interpolazione o anomalie nelle texture del veicolo e del paesaggio; questi sono segnali che frequentemente compaiono nei video manipolati con AI. Inoltre, la corrispondenza fra il danno fisico mostrato e le traiettorie plausibili dell'impatto è un controllo forense visivo utile per esperti e per giornalisti investigativi.

Infine, la verifica incrociata con dati esterni — come rapporti ufficiali della polizia, dichiarazioni di testimoni indipendenti e immagini di sorveglianza della strada — è fondamentale: la presenza di un'indagine ufficiale o di comunicati delle autorità, come riportato dalla stampa, può confermare che il video non sia l'unica fonte su cui basarsi e aiuta a stabilire l'attendibilità complessiva del materiale circolato.

Implicazioni etiche, legali e per l'informazione

La diffusione di un video che ritrae un incidente mortale solleva immediatamente questioni etiche: la condivisione di immagini sensibili può causare danno alle vittime e alle loro famiglie e favorire disinformazione se non verificata; per questo motivo molte redazioni e piattaforme sono giunte a politiche rigide sulla pubblicazione di contenuti grafici e sul divieto di uso di materiale personale per l'addestramento di AI, come ricordano le avvertenze di alcune testate.

Sul piano legale, la manipolazione di contenuti e la loro diffusione possono configurare responsabilità civili o penali, specialmente se il materiale è prodotto per diffamare, alterare un'inchiesta o trarre profitto; le indagini ufficiali sulle cause dell'incidente e sulle eventuali manipolazioni digitali sono quindi strumenti essenziali per stabilire responsabilità, come spesso riportato in articoli di cronaca che documentano l'apertura di inchieste dalle autorità locali.

Infine, per il giornalismo l'episodio è un richiamo alla necessità di verifiche rigorose: redazioni e fact-checker devono combinare competenze tecniche (analisi forense dei file), controlli classici (interviste, documenti ufficiali) e linee guida etiche per decidere se pubblicare, oscurare o accompagnare con avvertimenti i materiali sensibili, tutelando così il diritto all'informazione senza diventare veicolo di possibili manipolazioni.